A inteligência artificial é um dos assuntos mais incensados no mundo da tecnologia nos últimos tempos. Algoritmos para cá, machine learning para lá, criação de texto com o GPT-3 e a mais nova onda, a generative AI, que permite a criação de imagens a partir de frases curtas. Para alguns, estamos vivendo a era de ouro desse ramo da tecnologia. Mas nem todo mundo está tão satisfeito com o rumo que as coisas estão tomando.

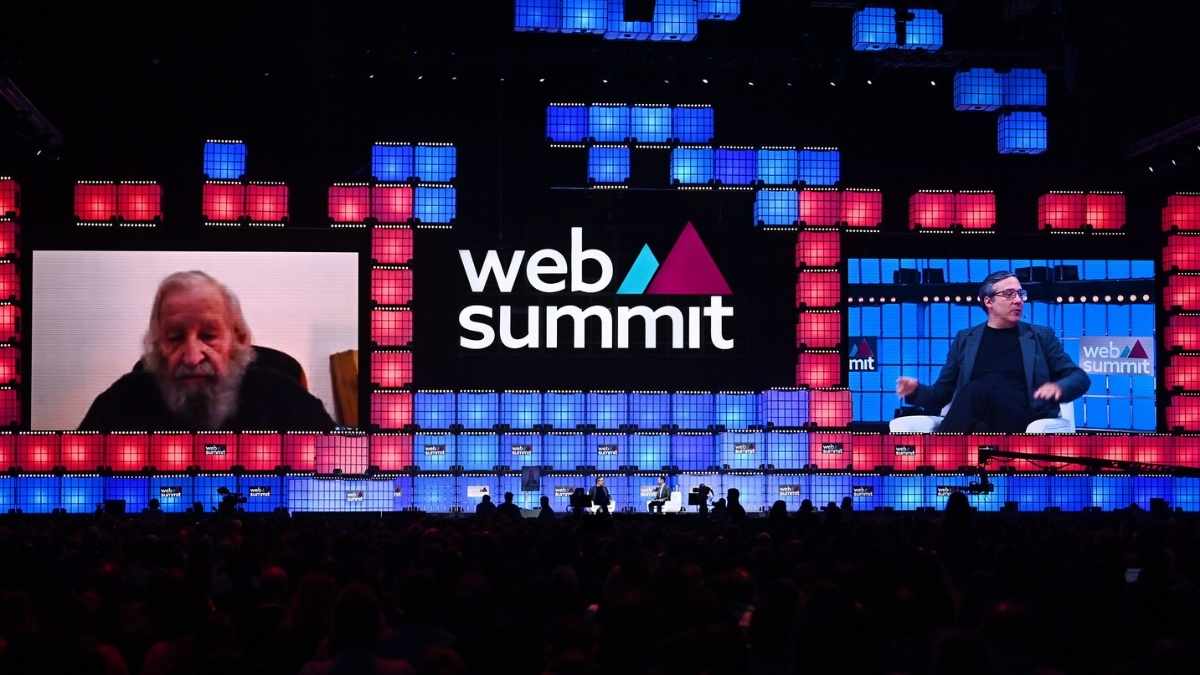

“Você pode criar coisas úteis como a transcrição simultânea de algo que é falado, mas não uma contribuição para o entendimento do mundo, e da linguagem, do processo cognitivo. Não consigo pensar em nada que esteja indo nessa direção”, disse o linguista Noam Chomsky no último painel do Web Summit, na sexta-feira (4). Pouco antes, o linguista, que participou por vídeoconferência, havia arrancado risadas da plateia ao relatar que, por problemas de audição, estava acompanhando o painel lendo a legenda gerada pelo computador. “É algo útil, mas é força bruta”, afirmou.

Chomsky, que tem 94 anos, lembrou que estava lá quando o ramo da inteligência artificial começou a ser estudado nos anos 1950. O artigo inaugural foi “Can Machines Think?”, de Alan Turing. Naquela época, contou, o objetivo era entender como se poderia usar as capacidades técnicas e intelectuais desenvolvidas na área de ciência da computação para tentar entender como os humanos pensam. “Hoje, isso é considerado fora de moda e foi substituído por se divertir com brinquedos caros”, afirmou.

Para ele, o uso de sistemas como o GPT-3 não faz o menor sentido, a não ser para ajudar estudantes a mentir em um trabalho, ou gastar muita energia na Califórnia. “Não tem nenhuma contribuição científica, nem para a engenharia”, completou.

A linha de raciocínio foi acompanhada pelo cientista Gary Marcus. “Estamos indo no caminho errado em inteligência artificial. O certo envolve olhar para os humanos e fazer a ciência. O que temos é algo que parece bom, mas não é tão profundo quanto a gente precisa”, afirmou.

Para ele, essa ilusão de que a inteligência artificial da forma como está sendo usada hoje é algo maravilhoso tira tempo e energia de atividades que poderiam contribuir mais para o entendimento de questões mais profundas sobre a humanidade, como ela entende a linguagem, o mundo. “É divertido brincar com essas coisas e é ok pra quem está fazendo isso, mas tira muita da energia. Se um estudante têm a opção entre estudar linguística ou trabalhar com GPT-3 e ganhar um monte de dinheiro, eles provavelmente vão escolher o GPT-3″, disse.

Mais isso é uma visão de curto prazo, acabramos como uma tecnologia que não vai durar tanto tempo”, avaliou. Segundo ele, a história da inteligência aritifical mostra que várias ondas vieram e foram embroa, e que e preciso ter coisas mais sustentávias. Ele ainda destacou o fato de a inteligências artificial perpetuar comportamentos expressos nas bases de dados que são usadas para alimantá-la. “Eles não entendem o mundo de fato. Isso sginifica que eles são sexistas, racistas. Eles não são construídos para ser assim, mas porque eles só copiam os dados que estão ali, e não tem valores sobre iguladade, por exemplo, eles perpetuam os viéses do passado”, disse.

Gary também destacou a questão de desinformação e o risco à democracia pela redução no custo para criação e divulgação de conteúdo falso em escala. “Você pode fazer a sua própria versão da GPT-3 por menos de US$ 500 mil. Se você é uma fábrica de trolls, isso é um ótimo investimenot, mas é péssimo para a sociedade.

Por último, ele falou da quantidad de recursos que têm sido investida em áreas como os carros autônomos. Até agora, já foram colocados US$ 100 bilhões em tecnologias nessa área, e nada aconteceu. “Talvez vá acontecer em 20 anos. Mas você não terá carros com automação nível 5, que você só coloca o endereço e ele vai, como Elon Musk vem pregando há 6 ou 7 anos. Isso não vai acontecer. É dinheiro que foi desperdiçado”, pontuou.

Mas como resolver tudo isso? Gary citou um artigo que ele escrevreu em 2020 com 4 recomendações: a inteligência artificial neuro-simbólica, que une as origens do campo com novas avanços; precisamos ter uma mais base de dados sobre conhecimento que as máquinas podem interpretar; é preciso criar formas de a inteligência artificial fazer ponderações como a mente humana faz e ter modelos cognitivos ue permitam fazer relação entre as coisas.